Introducción a Procore Analytics 2.0

Tabla de contenido

- Conector en la nube de Procore Analytics

- Comenzar configuración

- Elija un método de conexión de datos

- Conéctese a Power BI Desktop

- Conectarse a SQL Server mediante Python (SSIS)

- Conectarse a SQL Server mediante la biblioteca de Python

- Conectarse a SQL Server mediante Python Spark

- Conectarse a ADLS mediante Azure Functions

- Conectarse a ADLS mediante Python

- Conectarse a ADLS mediante Spark

- Conectar a Fabric Lakehouse mediante Data Factory

- Conectarse a Fabric Lakehouse mediante cuadernos de Fabric

- Conectarse a SQL Server mediante Azure Functions

- Conectarse a SQL Server mediante Data Factory

- Conectarse a SQL Server mediante Fabric Notebook

- Conectar a Databricks

- Conectarse a Snowflake usando Python

- Conectarse a Amazon S3 mediante Python

- Construya su propia conexión

Conector en la nube de Procore Analytics

Introducción

Cloud Connector es la forma en que Procore comparte datos, inteligencia y análisis con los clientes. Esto se puede compartir directamente con herramientas de informes como Power BI o Tableau. También se puede compartir con los almacenes de datos, las tiendas, los lagos u otras aplicaciones de los clientes. Los clientes pueden incluso crear acceso programático a sus datos utilizando Cloud Connector para una verdadera automatización. Cloud Connector se basa en el protocolo de uso compartido abierto de Delta Share.

Opciones del conector de datos guiado de Procore Analytics 2.0

Delta Sharing es el primer protocolo abierto de la industria para el intercambio seguro de datos, lo que simplifica el intercambio de datos con otras organizaciones, independientemente de las plataformas informáticas que utilicen. Muchas aplicaciones pueden acceder a los datos con Delta Share. Sin embargo, para mejorar aún más la experiencia del cliente, Procore ha añadido conectores, código prediseñado y guías para las siguientes plataformas, lo que reduce el tiempo y la complejidad de la configuración para permitir una conexión perfecta y lista para usar.

- servidor SQL

- Python de SSIS

- Biblioteca de Python

- Chispa de pitón

- Azure

- Funciones de ADLS en Azure

- Python para ADLS

- Spark de ADLS

- Factoría de datos de Lakehouse Fabric

- Cuaderno de tela de la casa del lago

- Funciones de SQL Server Azure

- Factoría de datos de SQL Server Fabric

- Cuaderno de SQL Server Fabric

- Ladrillos de datos

- copo de nieve

- Amazonas S3

- Guías para escribir el suyo propio (GitHub)

Próximamente habrá más conectores de datos.

Acceder a la documentación y al código

Hay documentación completa y ejemplos de códigos disponibles en el producto Procore Analytics directamente en la aplicación web de Procore a la que pueden acceder los administradores de Procore. Estos recursos proporcionan instrucciones paso a paso, fragmentos de código y buenas prácticas para ayudarlo a configurar y gestionar su integración de datos de manera efectiva.

Siguientes pasos

Continúe con la siguiente sección de esta guía para comenzar el proceso de configuración.

Para consultas o asistencia adicionales, póngase en contacto con su gestor de cuentas o con nuestro equipo de soporte.

Verificar permisos

Nota

- Debe tener la herramienta Analytics habilitada en el nivel de empresa para la cuenta de Procore de su empresa.

- Cualquier persona con acceso de nivel "Administrador" a la herramienta Analytics puede otorgar acceso a la herramienta Analytics a otros usuarios.

- Los usuarios deben tener acceso de nivel "Administrador" a la herramienta Analytics para generar un token de acceso.

- Cualquier cambio en los permisos de un usuario en el Directorio de Analytics tardará hasta 24 horas en estar activo.

Debe asegurarse de que se asignen los permisos adecuados para generar un token de acceso para poder comenzar a conectar sus datos de Procore a su solución de BI. El acceso a Analytics está vinculado a sus credenciales de inicio de sesión de Procore, lo que le permite generar un token de acceso único. El token de acceso es una cadena de dígitos que introducirá en el sistema de BI para acceder a los datos.

Normalmente, los usuarios que necesitan tokens de acceso son ingenieros de datos o desarrolladores de Power BI. Si tiene acceso a Analytics en varias empresas, su token le permitirá extraer datos de todas ellas. El token está vinculado a usted, no a una empresa específica, por lo que sigue siendo el mismo en todas las empresas a las que tiene acceso.

A los administradores de la empresa y del proyecto se les otorgará un rol de Administrador de forma predeterminada. Se permiten los siguientes niveles de acceso de usuario para la herramienta Analytics:

- Ninguno: no hay acceso a los datos de Analytics.

- Administrador: tiene permisos de acceso total a los datos de todas las herramientas y proyectos (excepto ciertos datos marcados como privados, como los datos de correspondencia).

Hay dos formas de asignar permisos a usuarios individuales:

Revocación de acceso

El acceso a los datos en la herramienta Analytics se revocará cuando se eliminen los permisos de un usuario para la herramienta. Además, si el registro de contacto de un usuario se vuelve inactivo, este también perderá el acceso a los datos de Analytics.

Generar credenciales de acceso a datos

Para comenzar a acceder a sus datos de Procore, hay dos opciones para generar sus credenciales de acceso a datos: el método de conexión directa de Databricks o el método de token de recurso compartido delta. El token de acceso es una cadena de dígitos que introducirá en el conector de datos correspondiente para acceder a los datos.

Consideraciones

- Debe tener habilitada la herramienta Procore Analytics.

- De forma predeterminada, todos los administradores de la empresa tienen acceso de nivel "Administrador" a Analytics en el directorio.

- Cualquier persona con acceso de nivel "Administrador" a Analytics puede otorgar acceso a la herramienta Analytics a otros usuarios.

- Los usuarios deben tener acceso de nivel "Administrador" a la herramienta Analytics para generar un token de datos.

Pasos

- Inicie sesión en Procore.

- Haga clic en el icono Cuenta y perfil en el área superior derecha de la barra de navegación.

- Haga clic en Configuración de mi perfil.

- En Elija su conexión con Procore Analytics, tiene dos opciones para generar credenciales:

- Los databricks se conectan directamente O BIEN generan un token de acceso personal con Delta Share.

- Introduzca su identificador de uso compartido de ladrillos para el método de conexión directa de los ladrillos y, a continuación, haga clic en Conectar. Consulte Conectar sus datos de Procore a un área de trabajo de ladrillos para más información.

- Para el método de token, seleccione Token de recurso compartido delta.

- Asegúrese de elegir una fecha de vencimiento.

- Haga clic en Generar tokens.

¡Importante! Se recomienda que copie y almacene su token para futuras consultas, ya que Procore no almacena tokens para los usuarios. - Utilizará su token de portador, el nombre del recurso compartido, la URL del servidor de uso compartido de Delta y la versión de las credenciales del recurso compartido para comenzar a acceder a sus datos e integrarlos.

- Explore las secciones adicionales de la Guía de inicio rápido para conocer los siguientes pasos para conectar sus datos según el método de conexión de datos que desee.

Nota

- El token desaparecerá después de una hora o también desaparecerá si sale de la página. Para generar un nuevo token, regrese al Paso 1.

- Los datos pueden tardar hasta 24 horas en ser visibles.

- No regenere su token durante este tiempo de procesamiento, ya que hacerlo puede causar problemas con su token.

Cargar informes en Power BI (si procede)

- Vaya a Procore Analytics desde el menú Herramientas de la empresa.

- Vaya a la sección Introducción .

- En Archivos de Power BI, seleccione y descargue los informes de Power BI disponibles.

- Inicie sesión en el servicio Power BI con sus credenciales de inicio de sesión de Power BI.

- Cree un espacio de trabajo donde desee almacenar los informes de Procore Analytics de su empresa. Consulte la documentación de soporte de Power BI de Microsoft para obtener más información.

Notas: Pueden aplicarse requisitos de licencia. - En el área de trabajo, haga clic en Cargar.

- Ahora haga clic en Examinar.

- Seleccione el archivo de informe desde su ubicación en la computadora y haga clic en Abrir.

- Después de cargar el archivo, haga clic en Filtrar y seleccione Modelo semántico.

- Coloque el cursor sobre la fila con el nombre del informe y haga clic en los puntos suspensivos verticales.

icono

icono - Haga clic en Configuración.

- En la página de configuración, haga clic en credenciales de origen de datos y, a continuación, en Editar credenciales.

- En la ventana "Configurar [Nombre del informe]" que aparece, realice lo siguiente:

- Método de autenticación: seleccione «Clave».

- Clave de cuenta: introduzca el token que recibió de la página de generación de tokens en Procore.

- Configuración de nivel de privacidad para esta fuente de datos: seleccione el nivel de privacidad. Recomendamos seleccionar "Privado" u "Organizacional". Consulte la documentación de soporte de Power BI de Microsoft para obtener más información sobre los niveles de privacidad.

- Haga clic en Iniciar sesión.

- Haga clic en Actualizar y haga lo siguiente:

- Zona horaria: seleccione la zona horaria que desea utilizar para las actualizaciones de datos programadas.

- En Configurar una planificación de actualización, active el conmutador de alternancia.

- Frecuencia de actualización: seleccione "Diario".

- Hora: haga clic en Añadir otra hora y seleccione 7:00 a.m.

Nota: Puede añadir hasta 8 horas de actualización. - Opcional:

- Marque la casilla "Enviar notificaciones de error de actualización al propietario del dataset" para enviar notificaciones de error de actualización.

- Introduzca las direcciones de correo electrónico de cualquier otro compañero al que desee que el sistema envíe notificaciones de error de actualización.

- Haga clic en Aplicar.

- Para verificar que los ajustes se configuraron correctamente y que los datos del informe se actualizarán correctamente, regrese a la página "Filtrar y seleccionar modelo semántico" y complete los siguientes pasos:

- Coloque el cursor sobre la fila que tiene el nombre del informe y haga clic en el icono de flecha circular para actualizar los datos manualmente.

- Compruebe la columna "Actualizado" para ver si hay un

icono de advertencia .

icono de advertencia .

- Si no se muestra ningún icono de advertencia, los datos del informe se han actualizado correctamente.

- Si aparece un icono de advertencia, se ha producido un error. Haga clic en el icono de advertencia

para ver más información sobre el error.

para ver más información sobre el error.

- Para eliminar el panel en blanco del servicio Power BI creado automáticamente, complete los siguientes pasos:

- Coloque el cursor sobre la fila que tiene el nombre del panel. Haga clic en el icono de la elipsis y haga

clic en Eliminar.

clic en Eliminar.

- Coloque el cursor sobre la fila que tiene el nombre del panel. Haga clic en el icono de la elipsis y haga

- Para verificar que el informe se muestre correctamente, vaya a la página "Todo" o "Contenido" y haga clic en el nombre del informe para verlo en el servicio Power BI.

Sugerencia

Haga referencia a la columna "Tipo" para asegurarse de hacer clic en el informe en lugar de en un activo diferente.

- Repita los pasos anteriores dentro de Power BI para cada archivo de informe de Procore Analytics.

Conéctese a Power BI Desktop

Nota

Estos métodos de conexión los suelen utilizar los profesionales de los datos.Conectar nuevos datos

- Abra el escritorio de Power BI.

- Haga clic en Obtener datos y seleccione Más.

- En la barra de búsqueda, escriba 'Delta Sharing'.

- Seleccione Delta Sharing y, a continuación, haga clic en Conectar.

- Escriba o pegue la URL del servidor de uso compartido delta que le envió Procore.

- Haga clic en Aceptar.

- Si es la primera vez que se conecta a esta fuente, se le pedirá que proporcione su token Delta Sharing Bearer.

- Haga clic en Conectar.

- Después de la autenticación, seleccione las tablas de Procore Analytics que desee incluir en su informe de Power BI.

- Seleccione Cargar para ver su informe o seleccione Transformar datos para realizar más transformaciones en Power Query.

Conectar con una plantilla existente

- Abra Power BI Desktop.

- Haga clic en el menú desplegable Transformar datos y seleccione Configuración de fuente de datos.

- Seleccione Editar permisos.

- Haga clic en Editar.

- Introduzca el token que ha recibido de Analytics 2.0.

- Haga clic en Actualizar.

- Las columnas de presupuesto personalizadas aparecerán ahora en las tablas Budget y BudgetSnapshots.

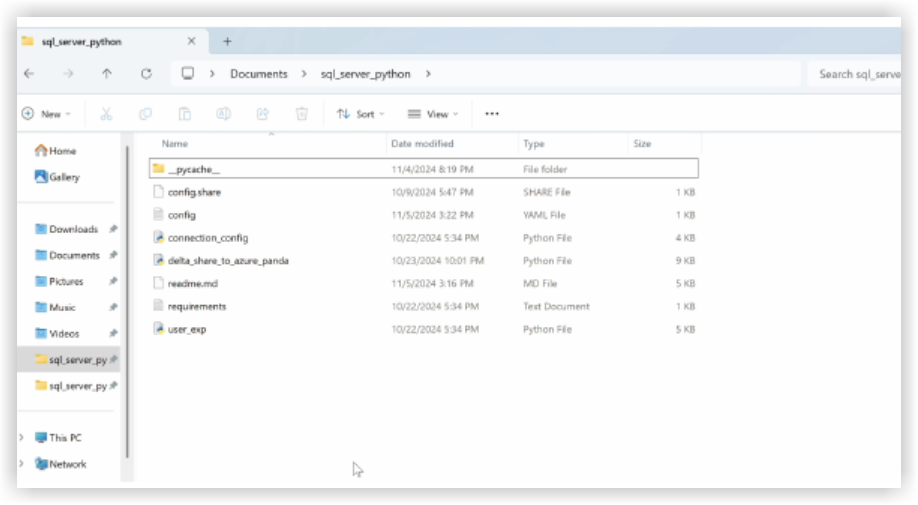

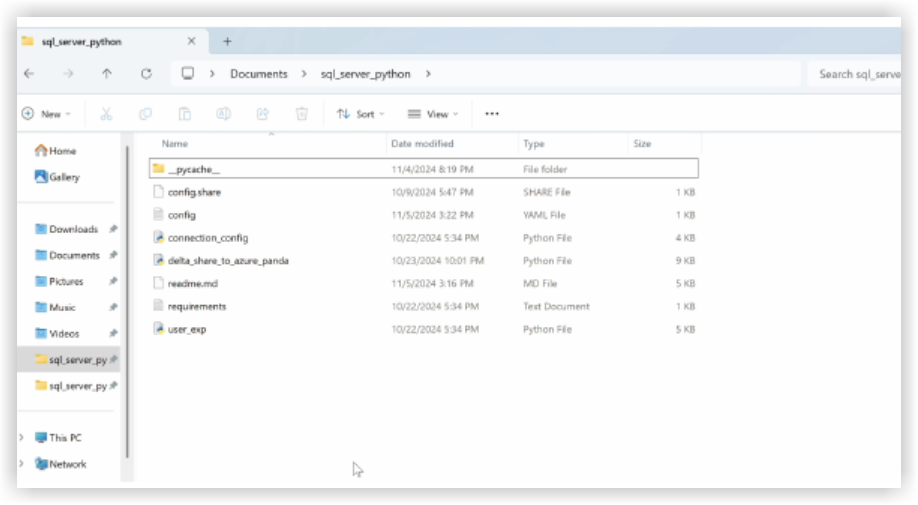

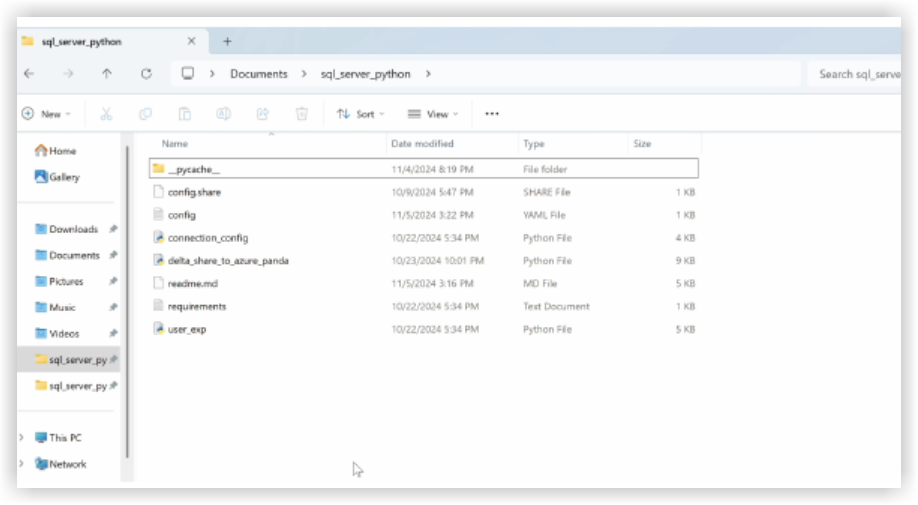

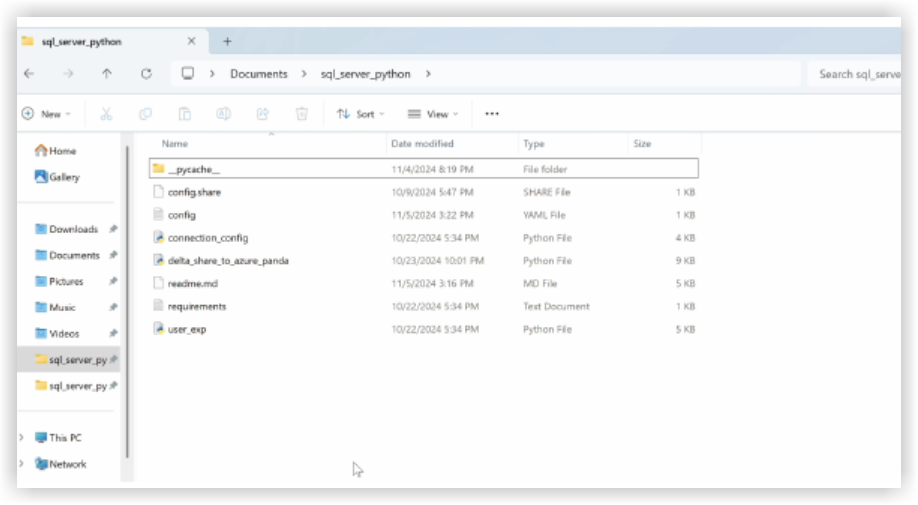

Conectarse a SQL Server mediante Python (SSIS)

Resumen

La herramienta Procore Analytics Cloud Connect Access es una interfaz de línea de comandos (CLI) que ayuda a configurar y gestionar las transferencias de datos de Procore a MS SQL Server. Consta de dos componentes principales:

- experiencia_usuario.py (Utilidad de configuración)

- delta_share_to_azure_panda.py (Script de sincronización de datos)

Requisitos

- Python y pip instalados en su sistema.

- Acceso a Procore Delta Share.

- credenciales de la cuenta de MS SQL Server.

- Instale las dependencias requeridas: pip install -rrequisites.txt.

Pasos

- Configuración inicial

- Sincronización de datos

- Configuración del recurso compartido delta

- Configuración del servidor MS SQL

- Configuración de SSIS

Configuración inicial

- Ejecute la utilidad de configuración:

python experiencia_usuario.py

Esto le ayudará a configurar lo siguiente:

- Configuración del origen del recurso compartido delta

- Configuración de destino de MS SQL Server

- Preferencias de planificación

Sincronización de datos

Después de la configuración, tiene dos opciones para ejecutar la sincronización de datos:

- Python de ejecución directa

delta_share_to_azure_panda.py

O - Ejecución planificada

Si se configura durante la configuración, el trabajo se ejecutará automáticamente de acuerdo con su planificación cron.

Configuración del recurso compartido delta

- Cree un nuevo archivo llamado config.share con sus credenciales de recurso compartido delta en formato JSON.

{

"shareCredentialsVersion": 1,

"bearerToken": "xxxxxxxxxxxxx",

"endpoint": "https://nvirginia. nube.databricks.c...astores/xxxxxx "

}

- Obtener los campos obligatorios:

Nota: Estos detalles se pueden obtener en la aplicación web Procore Analytics.- ShareCredentialsVersion: número de versión (actualmente 1).

- BearerToken: su token de acceso a recursos compartidos de Delta.

- Punto final: la URL de punto final de su recurso compartido delta.

- Guarde el archivo en una ubicación segura.

- Al configurar la fuente de datos, se le pedirá que proporcione:

- Lista de tablas (separadas por comas).

- Deje en blanco para sincronizar todas las tablas.

- Ejemplo: `tabla1,tabla2, tabla3`.

- Ruta a su archivo `config.share` archivo.

Configuración del servidor MS SQL

Deberá proporcionar los siguientes detalles de MS SQL Server:

- base de datos

- anfitrión

- contraseña

- esquema

- nombre de usuario

Configuración de SSIS

- Usando la línea de comando, vaya a la carpeta introduciendo"cd".<path to the folder>

- Instale los paquetes necesarios utilizando "pip install -rrequisites.txt"o"python -m pip install -rrequisites.txt".

- Abra SSIS y cree un nuevo proyecto.

- Desde el Cuadro de herramientas de SSIS, arrastrar y soltar la actividad "Ejecutar tarea de proceso".

- Haga doble clic en "Ejecutar tarea de proceso" y vaya a la pestaña Proceso.

- En "Ejecutable", introduzca la ruta de python.exe en la carpeta de instalación de python.

- En "WorkingDirectory", introduzca una ruta a la carpeta que contiene el script que desea ejecutar (sin el nombre del archivo de script).

- En "Argumentos", introduzca el nombre del script "delta_share_to_azure_panda.py". desea ejecutar con el.py extensión y guardar.

- Haga clic en el botón "Inicio" en el panel superior:

- Durante la ejecución de la tarea, el resultado de la consola de Python se muestra en la ventana de la consola externa.

- Una vez que la tarea haya finalizado, mostrará una marca de verificación verde:

Conectarse a SQL Server mediante la biblioteca de Python

Resumen

Esta guía proporciona instrucciones detalladas para configurar y utilizar el paquete de integración de uso compartido delta en un sistema operativo Windows para integrar sin problemas los datos en sus flujos de trabajo con Procore Analytics. El paquete admite múltiples opciones de ejecución, lo que le permite elegir la configuración y el método de integración deseados.

Requisitos

Asegúrese de tener lo siguiente antes de continuar:

- SKU de Procore Analytics 2.0

- Archivo de perfil de uso compartido delta:

Obtenga el archivo *.share que contiene las credenciales de uso compartido delta. Para mayor comodidad, cópielo en el directorio del paquete. - Entorno de Python: instale Python 3 y pip en el sistema.

- Descargar Python.

- Alternativamente, use Microsoft Store.

Pasos

- Preparar el paquete

- Instalar dependencias

- Generar configuración

- Configurar trabajos cron y ejecución inmediata

- Ejecución y mantenimiento

Preparar el paquete

- Cree un nuevo archivo llamado config.share con sus credenciales de recurso compartido delta en formato JSON.

{

"shareCredentialsVersion": 1,

"bearerToken": "xxxxxxxxxxxxx",

"endpoint": "https://nvirginia. nube.databricks.c...astores/xxxxxx "

}

- Obtener los campos obligatorios.

Nota: Estos detalles se pueden obtener en la aplicación web Procore Analytics.- ShareCredentialsVersion: número de versión (actualmente 1).

- BearerToken: su token de acceso a recursos compartidos de Delta.

- Punto final: la URL de punto final de su recurso compartido delta.

- Descargue y extraiga el paquete.

- Descomprima el paquete en un directorio de su elección.

- Copie el archivo de perfil *.share de uso compartido delta en el directorio del paquete para acceder fácilmente.

Instalar dependencias

- Abra un terminal en el directorio de paquetes.

- Ejecute el siguiente comando para instalar las dependencias:

- pip install -r requisitos.txt

Generar configuración

- Genere el archivo config.yaml ejecutando python user_exp.py:

Este script ayuda a generar el archivo config.yaml que contiene las credenciales y la configuración necesarias. - Al configurar la fuente de datos, se le pedirá que proporcione:

- Lista de tablas (separadas por comas).

- Deje en blanco para sincronizar todas las tablas.

Ejemplo: `tabla1, tabla2, tabla3`. - Ruta a su archivo `config.share` archivo.

- Por primera vez, proporcionará sus credenciales , como la ubicación de la configuración de origen del recurso compartido delta, las tablas, la base de datos, el host, etc.

Nota: Posteriormente, puede reutilizar o actualizar la configuración manualmente o ejecutando python user_exp.py nuevamente.

Configurar trabajos cron y ejecución inmediata (opcional)

- Decida si desea configurar un trabajo cron para la ejecución automática.

- Proporcione una planificación cron:

- Formato: * * * * * (minuto, hora, día del mes, mes, día de la semana).

- Ejemplo de ejecución diaria a las 2:00: 0 2 * * *

- Para comprobar los registros de planificación, se creará el archivo "procore_scheduling.log" en cuanto se configure la planificación.

También puede verificar la planificación ejecutando el comando en el terminal:

Para Linux y MacO:

Para editar/eliminar: edite el cron de planificación usando:

```golpe

EDITOR=nano crontab -e

```

- Después de ejecutar el comando anterior, debería ver algo similar a:

- 2 * * * * /Users/your_user/snowflake/venv/bin/python /Users/your_user/snowflake/sql_server_python/connection_config.py 2>&1 | while lee la línea; do echo "$(fecha) - $línea"; hecho >> /Users/su_usuario/copo de nieve/sql_server_python/procore_scheduling.log # procore-data-import

- También puede ajustar el cron de la planificación o eliminar toda la línea para detener su ejecución según la planificación.

Para Windows:

- Verifique que se haya creado la tarea de planificación:

```powershell

schtasks /query /tn "ProcoreDeltaShareScheduling" /fo LIST /v

``` - Para editar/eliminar - tarea de planificación:

Abra el Programador de tareas:- Pulse Win + R, escriba taskchd.msc, y pulse Intro.

- Vaya a las tareas planificadas.

- En el panel izquierdo, expanda la Biblioteca del planificador de tareas.

- Busque la carpeta donde está guardada su tarea (por ejemplo, la Biblioteca del Programador de tareas o una carpeta personalizada).

- Encuentre su tarea:

- Busque el nombre de la tarea ProcoreDeltaShareScheduling.

- Haga clic en él para ver sus detalles en el panel inferior.

- Verifique su planificación:

- Consulte la pestaña Desencadenadores para ver cuándo está configurada la ejecución de la tarea.

- Consulte la pestaña Historial para confirmar las ejecuciones recientes.

- Para eliminar una tarea:

- Eliminar tarea de la GUI.

Pregunta de ejecución inmediata:

- Opción de ejecutar un script para copiar datos inmediatamente después de la configuración.

- Después de generar config.yaml, la CLI está lista para ejecutarse en cualquier momento de forma independiente, ejecutando un script para copiar datos, según su paquete. Vea ejemplos a continuación:

pitón delta_share_to_azure_panda.py

O

python delta_share_to_sql_spark.py

O

pythondelta_share_to_azure_dfs_spark.py

Ejecución y mantenimiento

Problemas comunes y soluciones

- Configuración de trabajo cron:

- Asegúrese de que los permisos del sistema estén configurados correctamente.

- Consulte los registros del sistema si el trabajo no se ejecuta.

- Verifique que el script delta_share_to_azure_panda.py tenga permisos de ejecución.

- Archivo de configuración:

- Asegúrese de que el archivo config.yaml esté en el mismo directorio que el script.

- Haga una copia de seguridad del archivo antes de realizar cambios.

Soporte

Para obtener ayuda adicional:

- Revise los registros de scripts para ver los mensajes de error detallados.

- Vuelva a verificar el archivo config.yaml para ver si hay configuraciones incorrectas.

- Póngase en contacto con el administrador del sistema si tiene problemas relacionados con los permisos.

- Póngase en contacto con el soporte técnico de Procore para los problemas relacionados con el acceso a Delta Share.

- Revise el registro de tablas con errores: fail_tables.log.

Notas

- Siempre haga una copia de seguridad de sus archivos de configuración antes de realizar cambios.

- Pruebe nuevas configuraciones en un entorno que no sea de producción para evitar interrupciones.

Conectarse a SQL Server mediante Python Spark

Resumen

Esta guía proporciona instrucciones detalladas para configurar y utilizar el paquete de integración de uso compartido delta en un sistema operativo Windows para integrar sin problemas los datos en sus flujos de trabajo con Procore Analytics. El paquete admite múltiples opciones de ejecución, lo que le permite elegir la configuración y el método de integración deseados.

Requisitos

Asegúrese de tener lo siguiente antes de continuar:

- SKU de Procore Analytics 2.0

- Archivo de perfil de uso compartido delta:

Obtenga el archivo *.share que contiene las credenciales de uso compartido delta. Para mayor comodidad, cópielo en el directorio del paquete. - Entorno de Python: instale Python 3 y pip en el sistema.

- Descargar Python.

- Alternativamente, use Microsoft Store.

Pasos

- Preparar el paquete

- Instalar dependencias

- Generar configuración

- Configurar trabajos cron y ejecución inmediata

- Ejecución y mantenimiento

Preparar el paquete

- Cree un nuevo archivo llamado config.share con sus credenciales de recurso compartido delta en formato JSON.

{

"shareCredentialsVersion": 1,

"bearerToken": "xxxxxxxxxxxxx",

"endpoint": "https://nvirginia. nube.databricks.c...astores/xxxxxx "

}

- Obtener los campos obligatorios.

Nota: Estos detalles se pueden obtener en la aplicación web Procore Analytics.- ShareCredentialsVersion: número de versión (actualmente 1).

- BearerToken: su token de acceso a recursos compartidos de Delta.

- Punto final: la URL de punto final de su recurso compartido delta.

- Descargue y extraiga el paquete.

- Descomprima el paquete en un directorio de su elección.

- Copie el archivo de perfil *.share de uso compartido delta en el directorio del paquete para acceder fácilmente.

Instalar dependencias

- Abra un terminal en el directorio de paquetes.

- Ejecute el siguiente comando para instalar las dependencias:

- pip install -r requisitos.txt

Generar configuración

- Genere el archivo config.yaml ejecutando python user_exp.py:

Este script ayuda a generar el archivo config.yaml que contiene las credenciales y la configuración necesarias. - Al configurar la fuente de datos, se le pedirá que proporcione:

- Lista de tablas (separadas por comas).

- Deje en blanco para sincronizar todas las tablas.

Ejemplo: `tabla1, tabla2, tabla3`. - Ruta a su archivo `config.share` archivo.

- Por primera vez, proporcionará sus credenciales , como la ubicación de la configuración de origen del recurso compartido delta, las tablas, la base de datos, el host, etc.

Nota: Posteriormente, puede reutilizar o actualizar la configuración manualmente o ejecutando python user_exp.py nuevamente.

Configurar trabajos cron y ejecución inmediata (opcional)

- Decida si desea configurar un trabajo cron para la ejecución automática.

- Proporcione una planificación cron:

- Formato: * * * * * (minuto, hora, día del mes, mes, día de la semana).

- Ejemplo de ejecución diaria a las 2:00: 0 2 * * *

- Para comprobar los registros de planificación, se creará el archivo "procore_scheduling.log" en cuanto se configure la planificación.

También puede verificar la planificación ejecutando el comando en el terminal:

Para Linux y MacO:

Para editar/eliminar: edite el cron de planificación usando:

```golpe

EDITOR=nano crontab -e

```

- Después de ejecutar el comando anterior, debería ver algo similar a:

- 2 * * * * /Users/your_user/snowflake/venv/bin/python /Users/your_user/snowflake/sql_server_python/connection_config.py 2>&1 | while lee la línea; do echo "$(fecha) - $línea"; hecho >> /Users/su_usuario/copo de nieve/sql_server_python/procore_scheduling.log # procore-data-import

- También puede ajustar el cron de la planificación o eliminar toda la línea para detener su ejecución según la planificación.

Para Windows:

- Verifique que se haya creado la tarea de planificación:

```powershell

schtasks /query /tn "ProcoreDeltaShareScheduling" /fo LIST /v

``` - Para editar/eliminar - tarea de planificación:

Abra el Programador de tareas:- Pulse Win + R, escriba taskchd.msc, y pulse Intro.

- Vaya a las tareas planificadas.

- En el panel izquierdo, expanda la Biblioteca del planificador de tareas.

- Busque la carpeta donde está guardada su tarea (por ejemplo, la Biblioteca del Programador de tareas o una carpeta personalizada).

- Encuentre su tarea:

- Busque el nombre de la tarea ProcoreDeltaShareScheduling.

- Haga clic en él para ver sus detalles en el panel inferior.

- Verifique su planificación:

- Consulte la pestaña Desencadenadores para ver cuándo está configurada la ejecución de la tarea.

- Consulte la pestaña Historial para confirmar las ejecuciones recientes.

- Para eliminar una tarea:

- Eliminar tarea de la GUI.

Pregunta de ejecución inmediata:

- Opción de ejecutar un script para copiar datos inmediatamente después de la configuración.

- Después de generar config.yaml, la CLI está lista para ejecutarse en cualquier momento de forma independiente, ejecutando un script para copiar datos, según su paquete. Vea ejemplos a continuación:

pitón delta_share_to_azure_panda.py

O

python delta_share_to_sql_spark.py

O

pythondelta_share_to_azure_dfs_spark.py

Ejecución y mantenimiento

Problemas comunes y soluciones

- Configuración del trabajo de cron:

- Asegúrese de que los permisos del sistema estén configurados correctamente.

- Consulte los registros del sistema si el trabajo no se ejecuta.

- Verifique que el script delta_share_to_azure_panda.py tenga permisos de ejecución.

- Archivo de configuración:

- Asegúrese de que el archivo config.yaml esté en el mismo directorio que el script.

- Haga una copia de seguridad del archivo antes de realizar cambios.

Soporte

Para obtener ayuda adicional:

- Revise los registros de scripts para ver los mensajes de error detallados.

- Vuelva a verificar el archivo config.yaml para ver si hay configuraciones incorrectas.

- Póngase en contacto con el administrador del sistema si tiene problemas relacionados con los permisos.

- Póngase en contacto con el soporte técnico de Procore para los problemas relacionados con el acceso a Delta Share.

- Revise el registro de tablas con errores: fail_tables.log.

Notas

- Siempre haga una copia de seguridad de sus archivos de configuración antes de realizar cambios.

- Pruebe nuevas configuraciones en un entorno que no sea de producción para evitar interrupciones.

Conectarse a ADLS mediante Azure Functions

Resumen

Esta guía le guiará a través de la configuración e implementación de una función de Azure para integrar datos de colaboración delta con Procore Analytics. La función de Azure permite un procesamiento de datos eficiente y flujos de trabajo compartidos con perfiles de colaboración delta.

Requisitos

- SKU de Procore Analytics 2.0.

- Archivo de perfil de colaboración delta:

- Su archivo *.share que contiene las credenciales de uso compartido delta. Para mayor comodidad, colóquelo dentro del paquete descargado.

- Entorno de Python:

- Python 3.9+ instalado y pip en su sistema.

- Configuración de Azure:

- CLI de Azure instalada y con sesión iniciada.

- Herramientas esenciales instaladas.

Pasos

- Prepare the Package

- Install Dependencies

- Generate Configuration

- Azure CLI Setup

- Install Azure Functions Core Tools

- Prepare the Azure Function

- Deployment

- Validation

Preparar el paquete

- Descargue el paquete requerido (adls_azure_function o sql_server_azure_function).

- Extraiga los archivos del paquete en un directorio local.

- Coloque el archivo de uso compartido delta:

- Copie el archivo de perfil *.share de uso compartido delta en el directorio extraído.

Instalar dependencias

- Abra un terminal en el directorio de paquetes.

- Ejecute el siguiente comando para instalar las dependencias de Python necesarias:

- pip install -r requisitos.txt

Generar configuración

- Generar config.yaml archivo ejecutando:

- python experiencia_usuario.py

- El script le pedirá que introduzca credenciales como:

- Tablas

- Nombre de la base de datos

- anfitrión

- credenciales adicionales...

- La configuración se puede reutilizar o actualizar manualmente o volviendo a ejecutar python user_exp.py.

Configuración de la CLI de Azure

- Inicie sesión en Azure.

- Ejecute el siguiente comando para iniciar sesión:

inicio de sesión az - Verificar cuenta de Azure:

- Mostrar cuenta az

- Si la az no está disponible, instale la CLI de Azure siguiendo las instrucciones que se encuentran aquí: Microsoft Learn.

Instalar las Herramientas esenciales de Azure Functions

ir a

para obtener instrucciones sobre cómo instalar Azure Functions Herramientas esenciales.Preparar la función de Azure

- Utilizar elpara crear lo siguiente:

- Una aplicación de funciones

- Un grupo de recursos

- Plan de consumo

- Cuenta de almacenamiento

- Establecer planificación de cron personalizada (opcional).

- Abra function_app.py en un editor.

- Busque la línea: @app.timer_trigger(schedule="0 0 */8 * * *",

- Reemplace la planificación por su expresión de cron personalizada y guarde el archivo.

Despliegue

- Abra un terminal en el directorio del paquete (adls_azure_function).

- Ejecute el siguiente comando de implementación:

- func azure functionapp Publish <Nombre de la <FunctionAppName> aplicación de función> --build remoto --python --clean

- Reemplace <FunctionAppName> por el nombre de la aplicación de funciones de Azure en su suscripción de Azure.

Validación

- Asegúrese de que la implementación se realice correctamente comprobando en Azure Portal el estado de su aplicación de funciones.

- Supervise los registros para verificar que la función se ejecuta como se esperaba.

Conectarse a ADLS mediante Python

Resumen

Esta guía proporciona instrucciones detalladas para configurar y utilizar el paquete de integración de uso compartido delta en un sistema operativo Windows para integrar sin problemas los datos en sus flujos de trabajo con Procore Analytics. El paquete admite múltiples opciones de ejecución, lo que le permite elegir la configuración y el método de integración deseados.

Requisitos

Asegúrese de tener lo siguiente antes de continuar:

- SKU de Procore Analytics 2.0

- Archivo de perfil de uso compartido delta:

Obtenga el archivo *.share que contiene las credenciales de uso compartido delta. Para mayor comodidad, cópielo en el directorio del paquete. - Entorno de Python: instale Python 3 y pip en el sistema.

- Descargar Python.

- Alternativamente, use Microsoft Store.

Pasos

- Preparar el paquete

- Instalar dependencias

- Generar configuración

- Configurar trabajos cron y ejecución inmediata

- Ejecución y mantenimiento

Preparar el paquete

- Cree un nuevo archivo llamado config.share con sus credenciales de recurso compartido delta en formato JSON.

{

"shareCredentialsVersion": 1,

"bearerToken": "xxxxxxxxxxxxx",

"endpoint": "https://nvirginia. nube.databricks.c...astores/xxxxxx "

}

- Obtener los campos obligatorios.

Nota: Estos detalles se pueden obtener en la aplicación web Procore Analytics.- ShareCredentialsVersion: número de versión (actualmente 1).

- BearerToken: su token de acceso a recursos compartidos de Delta.

- Punto final: la URL de punto final de su recurso compartido delta.

- Descargue y extraiga el paquete.

- Descomprima el paquete en un directorio de su elección.

- Copie el archivo de perfil *.share de uso compartido delta en el directorio del paquete para acceder fácilmente.

Instalar dependencias

- Abra un terminal en el directorio de paquetes.

- Ejecute el siguiente comando para instalar las dependencias:

- pip install -r requisitos.txt

Generar configuración

- Genere el archivo config.yaml ejecutando python user_exp.py:

Este script ayuda a generar el archivo config.yaml que contiene las credenciales y la configuración necesarias. - Al configurar la fuente de datos, se le pedirá que proporcione:

- Lista de tablas (separadas por comas).

- Deje en blanco para sincronizar todas las tablas.

Ejemplo: `tabla1, tabla2, tabla3`. - Ruta a su archivo `config.share` archivo.

- Por primera vez, proporcionará sus credenciales , como la ubicación de la configuración de origen del recurso compartido delta, las tablas, la base de datos, el host, etc.

Nota: Posteriormente, puede reutilizar o actualizar la configuración manualmente o ejecutando python user_exp.py nuevamente.

Configurar trabajos cron y ejecución inmediata (opcional)

- Decida si desea configurar un trabajo cron para la ejecución automática.

- Proporcione una planificación cron:

- Formato: * * * * * (minuto, hora, día del mes, mes, día de la semana).

- Ejemplo de ejecución diaria a las 2:00: 0 2 * * *

- Para comprobar los registros de planificación, se creará el archivo "procore_scheduling.log" en cuanto se configure la planificación.

También puede verificar la planificación ejecutando el comando en el terminal:

Para Linux y MacO:

Para editar/eliminar: edite el cron de planificación usando:

```golpe

EDITOR=nano crontab -e

```

- Después de ejecutar el comando anterior, debería ver algo similar a:

- 2 * * * * /Users/your_user/snowflake/venv/bin/python /Users/your_user/snowflake/sql_server_python/connection_config.py 2>&1 | while lee la línea; do echo "$(fecha) - $línea"; hecho >> /Users/su_usuario/copo de nieve/sql_server_python/procore_scheduling.log # procore-data-import

- También puede ajustar el cron de la planificación o eliminar toda la línea para detener su ejecución según la planificación.

Para Windows:

- Verifique que se haya creado la tarea de planificación:

```powershell

schtasks /query /tn "ProcoreDeltaShareScheduling" /fo LIST /v

``` - Para editar/eliminar - tarea de planificación:

Abra el Programador de tareas:- Pulse Win + R, escriba taskchd.msc, y pulse Intro.

- Vaya a las tareas planificadas.

- En el panel izquierdo, expanda la Biblioteca del planificador de tareas.

- Busque la carpeta donde está guardada su tarea (por ejemplo, la Biblioteca del Programador de tareas o una carpeta personalizada).

- Encuentre su tarea:

- Busque el nombre de la tarea ProcoreDeltaShareScheduling.

- Haga clic en él para ver sus detalles en el panel inferior.

- Verifique su planificación:

- Consulte la pestaña Desencadenadores para ver cuándo está configurada la ejecución de la tarea.

- Consulte la pestaña Historial para confirmar las ejecuciones recientes.

- Para eliminar una tarea:

- Eliminar tarea de la GUI.

Pregunta de ejecución inmediata:

- Opción de ejecutar un script para copiar datos inmediatamente después de la configuración.

- Después de generar config.yaml, la CLI está lista para ejecutarse en cualquier momento de forma independiente, ejecutando un script para copiar datos, según su paquete. Vea ejemplos a continuación:

pitón delta_share_to_azure_panda.py

O

python delta_share_to_sql_spark.py

O

pythondelta_share_to_azure_dfs_spark.py

Ejecución y mantenimiento

Problemas comunes y soluciones

- Configuración de trabajo cron:

- Asegúrese de que los permisos del sistema estén configurados correctamente.

- Consulte los registros del sistema si el trabajo no se ejecuta.

- Verifique que el script delta_share_to_azure_panda.py tenga permisos de ejecución.

- Archivo de configuración:

- Asegúrese de que el archivo config.yaml esté en el mismo directorio que el script.

- Haga una copia de seguridad del archivo antes de realizar cambios.

Soporte

Para obtener ayuda adicional:

- Revise los registros de scripts para ver los mensajes de error detallados.

- Vuelva a verificar el archivo config.yaml para ver si hay configuraciones incorrectas.

- Póngase en contacto con el administrador del sistema si tiene problemas relacionados con los permisos.

- Póngase en contacto con el soporte técnico de Procore para los problemas relacionados con el acceso a Delta Share.

- Revise el registro de tablas con errores: fail_tables.log.

Notas

- Siempre haga una copia de seguridad de sus archivos de configuración antes de realizar cambios.

- Pruebe nuevas configuraciones en un entorno que no sea de producción para evitar interrupciones.

Conectarse a ADLS mediante Spark

Resumen

Esta guía proporciona instrucciones detalladas para configurar y utilizar el paquete de integración de uso compartido delta en un sistema operativo Windows para integrar sin problemas los datos en sus flujos de trabajo con Procore Analytics. El paquete admite múltiples opciones de ejecución, lo que le permite elegir la configuración y el método de integración deseados.

Requisitos

Asegúrese de tener lo siguiente antes de continuar:

- SKU de Procore Analytics 2.0

- Archivo de perfil de uso compartido delta:

Obtenga el archivo *.share que contiene las credenciales de uso compartido delta. Para mayor comodidad, cópielo en el directorio del paquete. - Entorno de Python: instale Python 3 y pip en el sistema.

- Descargar Python.

- Alternativamente, use Microsoft Store.

Pasos

- Preparar el paquete

- Instalar dependencias

- Generar configuración

- Configurar trabajos cron y ejecución inmediata

- Ejecución y mantenimiento

Preparar el paquete

- Cree un nuevo archivo llamado config.share con sus credenciales de recurso compartido delta en formato JSON.

{

"shareCredentialsVersion": 1,

"bearerToken": "xxxxxxxxxxxxx",

"endpoint": "https://nvirginia. nube.databricks.c...astores/xxxxxx "

}

- Obtener los campos obligatorios.

Nota: Estos detalles se pueden obtener en la aplicación web Procore Analytics.- ShareCredentialsVersion: número de versión (actualmente 1).

- BearerToken: su token de acceso a recursos compartidos de Delta.

- Punto final: la URL de punto final de su recurso compartido delta.

- Descargue y extraiga el paquete.

- Descomprima el paquete en un directorio de su elección.

- Copie el archivo de perfil *.share de uso compartido delta en el directorio del paquete para acceder fácilmente.

Instalar dependencias

- Abra un terminal en el directorio de paquetes.

- Ejecute el siguiente comando para instalar las dependencias:

- pip install -r requisitos.txt

Generar configuración

- Genere el archivo config.yaml ejecutando python user_exp.py:

Este script ayuda a generar el archivo config.yaml que contiene las credenciales y la configuración necesarias. - Al configurar la fuente de datos, se le pedirá que proporcione:

- Lista de tablas (separadas por comas).

- Deje en blanco para sincronizar todas las tablas.

Ejemplo: `tabla1, tabla2, tabla3`. - Ruta a su archivo `config.share` archivo.

- Por primera vez, proporcionará sus credenciales , como la ubicación de la configuración de origen del recurso compartido delta, las tablas, la base de datos, el host, etc.

Nota: Posteriormente, puede reutilizar o actualizar la configuración manualmente o ejecutando python user_exp.py nuevamente.

Configurar trabajos cron y ejecución inmediata (opcional)

- Decida si desea configurar un trabajo cron para la ejecución automática.

- Proporcione una planificación cron:

- Formato: * * * * * (minuto, hora, día del mes, mes, día de la semana).

- Ejemplo de ejecución diaria a las 2:00: 0 2 * * *

- Para comprobar los registros de planificación, se creará el archivo "procore_scheduling.log" en cuanto se configure la planificación.

También puede verificar la planificación ejecutando el comando en el terminal:

Para Linux y MacO:

Para editar/eliminar: edite el cron de planificación usando:

```golpe

EDITOR=nano crontab -e

```

- Después de ejecutar el comando anterior, debería ver algo similar a:

- 2 * * * * /Users/your_user/snowflake/venv/bin/python /Users/your_user/snowflake/sql_server_python/connection_config.py 2>&1 | while lee la línea; do echo "$(fecha) - $línea"; hecho >> /Users/su_usuario/copo de nieve/sql_server_python/procore_scheduling.log # procore-data-import

- También puede ajustar el cron de la planificación o eliminar toda la línea para detener su ejecución según la planificación.

Para Windows:

- Verifique que se haya creado la tarea de planificación:

```powershell

schtasks /query /tn "ProcoreDeltaShareScheduling" /fo LIST /v

``` - Para editar/eliminar - tarea de planificación:

Abra el Programador de tareas:- Pulse Win + R, escriba taskchd.msc, y pulse Intro.

- Vaya a las tareas planificadas.

- En el panel izquierdo, expanda la Biblioteca del planificador de tareas.

- Busque la carpeta donde está guardada su tarea (por ejemplo, la Biblioteca del Programador de tareas o una carpeta personalizada).

- Encuentre su tarea:

- Busque el nombre de la tarea ProcoreDeltaShareScheduling.

- Haga clic en él para ver sus detalles en el panel inferior.

- Verifique su planificación:

- Consulte la pestaña Desencadenadores para ver cuándo está configurada la ejecución de la tarea.

- Consulte la pestaña Historial para confirmar las ejecuciones recientes.

- Para eliminar una tarea:

- Eliminar tarea de la GUI.

Pregunta de ejecución inmediata:

- Opción de ejecutar un script para copiar datos inmediatamente después de la configuración.

- Después de generar config.yaml, la CLI está lista para ejecutarse en cualquier momento de forma independiente, ejecutando un script para copiar datos, según su paquete. Vea ejemplos a continuación:

pitón delta_share_to_azure_panda.py

O

python delta_share_to_sql_spark.py

O

pythondelta_share_to_azure_dfs_spark.py

Ejecución y mantenimiento

Problemas comunes y soluciones

- Configuración del trabajo de cron:

- Asegúrese de que los permisos del sistema estén configurados correctamente.

- Consulte los registros del sistema si el trabajo no se ejecuta.

- Verifique que el script delta_share_to_azure_panda.py tenga permisos de ejecución.

- Archivo de configuración:

- Asegúrese de que el archivo config.yaml esté en el mismo directorio que el script.

- Haga una copia de seguridad del archivo antes de realizar cambios.

Soporte

Para obtener ayuda adicional:

- Revise los registros de scripts para ver los mensajes de error detallados.

- Vuelva a verificar el archivo config.yaml para ver si hay configuraciones incorrectas.

- Póngase en contacto con el administrador del sistema si tiene problemas relacionados con los permisos.

- Póngase en contacto con el soporte técnico de Procore para los problemas relacionados con el acceso a Delta Share.

- Revise el registro de tablas con errores: fail_tables.log.

Notas

- Siempre haga una copia de seguridad de sus archivos de configuración antes de realizar cambios.

- Pruebe nuevas configuraciones en un entorno que no sea de producción para evitar interrupciones.

Conectar a Fabric Lakehouse mediante Data Factory

Resumen

La integración del uso compartido delta con Microsoft Fabric Data Factory permite el acceso y el procesamiento sin problemas de las tablas delta compartidas para sus flujos de trabajo de análisis con Procore Analytics 2.0. Delta Sharing, un protocolo abierto para la colaboración segura de datos, garantiza que las organizaciones puedan compartir datos sin duplicación.

Requisitos

- SKU de Procore Analytics 2.0

- Credenciales de uso compartido delta:

- Obtenga el archivo de credenciales de usocompartido delta share.json (o equivalente) de su proveedor de datos.

- Este archivo debe incluir:

- URL de punto final. La URL del servidor de uso compartido delta.

- Token de portador: se utiliza para el acceso seguro a los datos.

- Configuración de Microsoft Fabric:

- Una cuenta de arrendatario de Microsoft Fabric con una suscripción activa.

- Acceso a un área de trabajo compatible con Microsoft Fabric.

Pasos

- Cambiar a la experiencia de la factoría de datos

- Configurar el flujo de datos

- Realizar transformaciones de datos

- Validación y seguimiento

Cambiar a la experiencia de la factoría de datos

- Vaya a Microsoft Fabric Workspace.

- Seleccione Nuevo y, a continuación,elija Dataflow Gen2.

Configurar el flujo de datos

- Vaya al editor de flujos de datos.

- Haga clic en Obtener datos y seleccione Más.

- En Nuevo origen, seleccione Otros de colaboración delta como origen de datos.

- Introduzca los siguientes detalles:

- URL: del archivo de configuración de uso compartido delta.

- Token de portador: se encuentra en el archivo config.share.

- Haga clic en Siguiente y seleccione las tablas deseadas.

- Haga clic en Crear para completar la configuración.

Realizar transformaciones de datos

Después de configurar el flujo de datos, ahora puede aplicar transformaciones a los datos delta compartidos. Elija su opción de datos compartidos delta de la lista siguiente:

- Añadir destino de datos

- Crear/Abrir refugio del lago

Añadir destino de datos

- Vaya a Factoría de datos.

- Haga clic en Añadir destino de datos.

- Seleccione Lakehouse como destino y haga clic en Siguiente.

- Elija su objetivo de destino y confírmelo haciendo clic en Siguiente.

Crear: abrir la casita del lago

- Cree/abra su lago y haga clic en Obtener datos.

- Seleccione Nuevo Dataflow Gen2.

- Haga clic en Obtener datos, luego en Más y busque Uso compartido delta.

- Introduzca el token de portador de URL del archivo config.share y luego seleccione Siguiente.

- Elija los datos o las tablas que desea descargar y haga clic en Siguiente.

- Después de estas manipulaciones, debería tener todos los datos seleccionados en Fabric Lakehouse.

Validación y seguimiento

Pruebe sus flujos y canalizaciones de datos para garantizar una ejecución sin problemas. Utilice herramientas de supervisión dentro de los datos.

Factory para realizar un seguimiento del progreso y los registros de cada actividad.

Conectarse a Fabric Lakehouse mediante cuadernos de Fabric

Resumen

El uso de Data Factory en Microsoft Fabric con uso compartido delta permite una integración y un procesamiento perfectos de las tablas delta compartidas como parte de sus flujos de trabajo de análisis con Procore Analytics 2.0. Delta Sharing es un protocolo abierto para compartir datos de forma segura, lo que permite la colaboración entre organizaciones sin duplicar datos.

Esta guía le indica los pasos para configurar y utilizar Data Factory in Fabric con uso compartido delta, utilizando blocs de notas para procesar y exportar datos a un lago.

Requisitos

- SKU de Procore Analytics 2.0

- Credenciales de uso compartido delta:

- Acceso a las credenciales de uso compartido delta proporcionadas por un proveedor de datos.

- Un archivo de perfil para compartir (config.share) que contiene:

- URL de extremo ( URL del servidor de uso compartido de Delta).

- Access Token (token al portador para el acceso seguro a los datos).

- Cree su archivo config.yaml con credenciales específicas.

- Entorno de Microsoft Fabric:

- Una cuenta de arrendatario de Microsoft Fabric con una suscripción activa.

- Un espacio de trabajo habilitado para Fabric.

- Paquetes y scripts:

- Descargue el paquete fabric-lakehouse. El directorio debe incluir:

- ds_to_lakehouse.py: Código del bloc de notas.

- Léame.md: Instrucciones.

- Descargue el paquete fabric-lakehouse. El directorio debe incluir:

Pasos

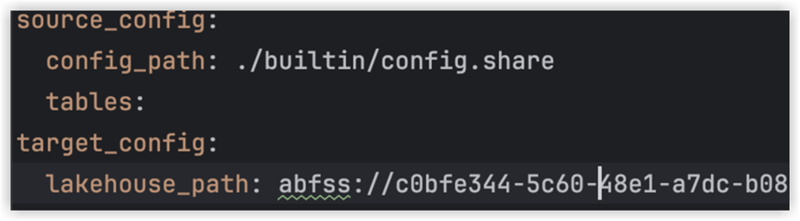

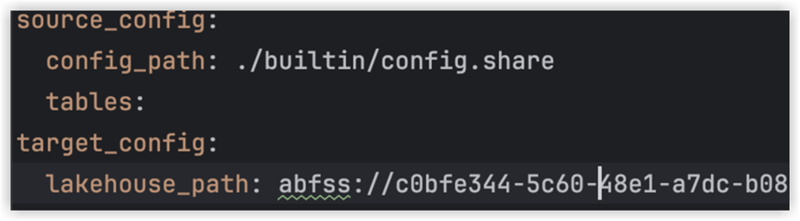

Configurar configuración

- Crear config.yaml y defina la configuración en la siguiente estructura

configuración_fuente:

config_path: ruta/a/su/archivo-de-credenciales-para-compartir-delta.share.

tablas: # Opcional - Dejar en blanco para procesar todas las tablas

- nombre_tabla1

- nombre_tabla2

configuración_destino:

lakehouse_path: ruta/a/su/fabric/lakehouse/Tables/ # Ruta a Fabric Lakehouse

Configurar la casa del lago

- Abra su área de trabajo de Microsoft Fabric.

- Vaya a Lakehouse y haga clic en Abrir libreta y luego en Nueva libreta.

- Si no conoce el valor en config.yaml#lakehouse_path, puede copiarlo desde la pantalla.

- Haga clic en los puntos suspensivos en Archivos y seleccione Copiar ruta ABFS: clipboard_e390331535300f7f89fd0a91c9a3adebe.png" src="./clipboard_e390331535300f7f89fd0a91c9a3adebe.png" />

3. Copie el código de ds_to_lakehouse.py y péguelo en la ventana del cuaderno (Pyspark Python):

El siguiente paso es cargar su propio config.yaml y config.share en la carpeta Resources de Lakehouse. Puede crear su propio directorio o utilizar un directorio integrado (ya creado para recursos por Lakehouse):

El siguiente ejemplo muestra un directorio integrado estándar para un archivo config.yaml.

Nota: asegúrese de cargar ambos archivos en el mismo nivel y para la propiedad config_path:

4. Verifique el código del bloc de notas, líneas 170-175.

El siguiente ejemplo muestra los cambios de línea necesarios:

ruta_config = "./env/config.yaml"

a

ruta_config = "./incorporado/config.yaml "

Dado que los archivos están en una carpeta integrada y no en un sobre personalizado, asegúrese de supervisar su propia estructura de archivos. Puede cargarlos en diferentes carpetas, pero en tales casos, actualice el código del cuaderno para encontrar el archivo config.yaml correctamente.

5. Haga clic en Ejecutar celda:

Validación

- Una vez que se complete el trabajo, verifique que los datos se hayan copiado correctamente en la casa del lago.

- Verifique las tablas especificadas y asegúrese de que los datos coincidan con las tablas delta compartidas.

- Espere hasta que termine el trabajo; debería copiar todos los datos.

Conectarse a SQL Server mediante Azure Functions

Resumen

Esta guía le guiará a través de la configuración e implementación de una función de Azure para integrar datos de colaboración delta con Procore Analytics. La función de Azure permite un procesamiento de datos eficiente y flujos de trabajo compartidos con perfiles de colaboración delta.

Requisitos

- SKU de Procore Analytics 2.0.

- Archivo de perfil de colaboración delta:

- Su archivo *.share que contiene las credenciales de uso compartido delta. Para mayor comodidad, colóquelo dentro del paquete descargado.

- Entorno de Python:

- Python 3.9+ instalado y pip en su sistema.

- Configuración de Azure:

- CLI de Azure instalada y con sesión iniciada.

- Herramientas esenciales instaladas.

Pasos

- Prepare the Package

- Install Dependencies

- Generate Configuration

- Azure CLI Setup

- Install Azure Functions Core Tools

- Prepare the Azure Function

- Deployment

- Validation

Preparar el paquete

- Descargue el paquete requerido (adls_azure_function o sql_server_azure_function).

- Extraiga los archivos del paquete en un directorio local.

- Coloque el archivo de uso compartido delta:

- Copie el archivo de perfil *.share de uso compartido delta en el directorio extraído.

Instalar dependencias

- Abra un terminal en el directorio de paquetes.

- Ejecute el siguiente comando para instalar las dependencias de Python necesarias:

- pip install -r requisitos.txt

Generar configuración

- Generar config.yaml archivo ejecutando:

- python experiencia_usuario.py

- El script le pedirá que introduzca credenciales como:

- Tablas

- Nombre de la base de datos

- anfitrión

- credenciales adicionales...

- La configuración se puede reutilizar o actualizar manualmente o volviendo a ejecutar python user_exp.py.

Configuración de la CLI de Azure

- Inicie sesión en Azure.

- Ejecute el siguiente comando para iniciar sesión:

inicio de sesión az - Verificar cuenta de Azure:

- Mostrar cuenta az

- Si la az no está disponible, instale la CLI de Azure siguiendo las instrucciones que se encuentran aquí: Microsoft Learn.

Instalar las Herramientas esenciales de Azure Functions

ir a

para obtener instrucciones sobre cómo instalar Azure Functions Herramientas esenciales.Preparar la función de Azure

- Utilizar elpara crear lo siguiente:

- Una aplicación de funciones

- Un grupo de recursos

- Plan de consumo

- Cuenta de almacenamiento

- Establecer planificación de cron personalizada (opcional).

- Abra function_app.py en un editor.

- Busque la línea: @app.timer_trigger(schedule="0 0 */8 * * *",

- Reemplace la planificación por su expresión de cron personalizada y guarde el archivo.

Despliegue

- Abra un terminal en el directorio del paquete (adls_azure_function).

- Ejecute el siguiente comando de implementación:

- func azure functionapp Publish <Nombre de la <FunctionAppName> aplicación de función> --build remoto --python --clean

- Reemplace <FunctionAppName> por el nombre de la aplicación de funciones de Azure en su suscripción de Azure.

Validación

- Asegúrese de que la implementación se realice correctamente comprobando en Azure Portal el estado de su aplicación de funciones.

- Supervise los registros para verificar que la función se ejecuta como se esperaba.

Conectarse a SQL Server mediante Data Factory

Resumen

Este documento proporciona instrucciones paso a paso para configurar una canalización de datos en Microsoft Fabric para transferir datos del recurso compartido delta a un almacén de SQL. Esta configuración permite una integración de datos perfecta entre los orígenes de Delta Lake y los destinos de SQL.

Requisitos

- Cuenta de Microsoft Fabric activa con los permisos adecuados.

- credenciales de recurso compartido delta.

- credenciales de almacén de SQL.

- Acceso a Data Flow Gen2 en Fabric.

Pasos

- Acceder al flujo de datos de 2.ª generación

- Configurar fuentede datos

- Configurar conexión delta compartida

- Configurar destino de datos

- Finalizar e implementar

- Verificación

- Resolución de problemas

Acceder al flujo de datos de 2.ª generación

- Inicie sesión en su cuenta de Microsoft Fabric.

- Vaya al área de trabajo.

- Seleccione "Flujo de datos Gen2" entre las opciones disponibles.

Configurar fuente de datos

- Haga clic en "Datos de otra fuente" para comenzar la configuración.

- Desde la pantalla Obtener datos, haga lo siguiente:

- Busque la barra de búsqueda con la etiqueta "Elegir fuente de datos".

- Escriba "uso compartido delta" en el campo de búsqueda.

- Seleccione Colaboración delta en los resultados.

Configurar conexión delta compartida

- Introduzca sus credenciales de Delta Share cuando se le solicite.

- Asegúrese de que todos los campos obligatorios se completen con precisión.

- Valide la conexión si es posible.

- Haga clic en "Siguiente" para continuar.

- Revise la lista de tablas disponibles:

- Se mostrarán todas las mesas a las que tenga acceso.

- Seleccione las tablas deseadas para la transferencia.

Configurar destino de datos

- Haga clic en "Añadir destino de datos".

- Seleccione "Almacén SQL" como destino.

- Introduzca las credenciales de SQL:

- Detalles del servidor.

- Información de autenticación.

- especificaciones de la base de datos.

- Verifique la configuración de la conexión.

Finalizar e implementar

- Revise todas las configuraciones.

- Haga clic en "Publicar" para implementar el flujo de datos.

- Espere el mensaje de confirmación.

Verificación

- Acceda a su almacén de SQL.

- Verifique que los datos estén disponibles y correctamente estructurados.

- Ejecute consultas de prueba para garantizar la integridad de los datos.

Resolución de problemas

Problemas comunes y soluciones:

- Errores de conexión: verifique las credenciales y la conectividad de red.

- Faltan tablas: verifique los permisos del recurso compartido delta.

- Problemas de rendimiento: revise la asignación de recursos y la configuración de optimización.

Conectarse a SQL Server mediante Fabric Notebook

Resumen

El uso de Data Factory en Microsoft Fabric con uso compartido delta permite una integración y un procesamiento perfectos de las tablas delta compartidas como parte de sus flujos de trabajo de análisis con Procore Analytics 2.0. Delta Sharing es un protocolo abierto para compartir datos de forma segura, lo que permite la colaboración entre organizaciones sin duplicar datos.

Esta guía le indica los pasos para configurar y utilizar Data Factory in Fabric con uso compartido delta, utilizando blocs de notas para procesar y exportar datos a un lago.

Requisitos

- SKU de Procore Analytics 2.0

- Credenciales de uso compartido delta:

- Acceso a las credenciales de uso compartido delta proporcionadas por un proveedor de datos.

- Un archivo de perfil para compartir (config.share) que contiene:

- URL de extremo ( URL del servidor de uso compartido de Delta).

- Access Token (token al portador para el acceso seguro a los datos).

- Cree su archivo config.yaml con credenciales específicas.

- Entorno de Microsoft Fabric:

- Una cuenta de arrendatario de Microsoft Fabric con una suscripción activa.

- Un espacio de trabajo habilitado para Fabric.

- Paquetes y scripts:

- Descargue el paquete fabric-lakehouse. El directorio debe incluir:

- ds_to_lakehouse.py: Código del bloc de notas.

- Léame.md: Instrucciones.

- Descargue el paquete fabric-lakehouse. El directorio debe incluir:

Pasos

Configurar configuración

- Crear config.yaml y defina la configuración en la siguiente estructura

configuración_fuente:

config_path: ruta/a/su/archivo-de-credenciales-para-compartir-delta.share.

tablas: # Opcional - Dejar en blanco para procesar todas las tablas

- nombre_tabla1

- nombre_tabla2

configuración_destino:

lakehouse_path: ruta/a/su/fabric/lakehouse/Tables/ # Ruta a Fabric Lakehouse

Configurar la casa del lago

- Abra su área de trabajo de Microsoft Fabric.

- Vaya a Lakehouse y haga clic en Abrir libreta y luego en Nueva libreta.

- Si no conoce el valor en config.yaml#lakehouse_path, puede copiarlo desde la pantalla.

- Haga clic en los puntos suspensivos en Archivos y seleccione Copiar ruta ABFS: clipboard_e390331535300f7f89fd0a91c9a3adebe.png" src="./clipboard_e390331535300f7f89fd0a91c9a3adebe.png" />

3. Copie el código de ds_to_lakehouse.py y péguelo en la ventana del cuaderno (Pyspark Python):

El siguiente paso es cargar su propio config.yaml y config.share en la carpeta Resources de Lakehouse. Puede crear su propio directorio o utilizar un directorio integrado (ya creado para recursos por Lakehouse):

El siguiente ejemplo muestra un directorio integrado estándar para un archivo config.yaml.

Nota: asegúrese de cargar ambos archivos en el mismo nivel y para la propiedad config_path:

4. Verifique el código del bloc de notas, líneas 170-175.

El siguiente ejemplo muestra los cambios de línea necesarios:

ruta_config = "./env/config.yaml"

a

ruta_config = "./incorporado/config.yaml "

Dado que los archivos están en una carpeta integrada y no en un sobre personalizado, asegúrese de supervisar su propia estructura de archivos. Puede cargarlos en diferentes carpetas, pero en tales casos, actualice el código del cuaderno para encontrar el archivo config.yaml correctamente.

5. Haga clic en Ejecutar celda:

Validación

- Una vez que se complete el trabajo, verifique que los datos se hayan copiado correctamente en la casa del lago.

- Verifique las tablas especificadas y asegúrese de que los datos coincidan con las tablas delta compartidas.

- Espere hasta que termine el trabajo; debería copiar todos los datos.

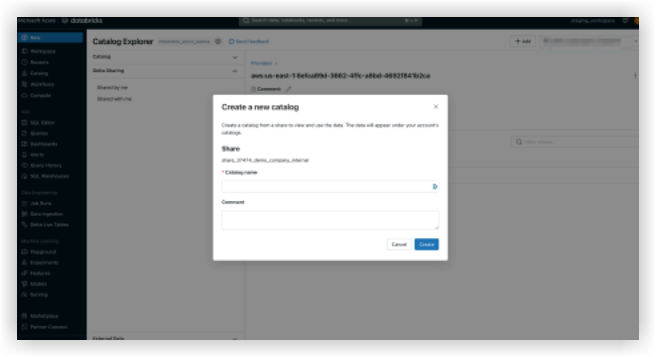

Conectar a Databricks

Nota

Los profesionales de los datos suelen utilizar este método de conexión.- Inicie sesión en el entorno de Databricks.

- Vaya a la sección Catálogo .

- Seleccione Compartir delta en el menú superior.

- Seleccione Compartido conmigo.

- Copie el identificador de uso compartido que se le proporcionó.

- Comparta el identificador de colaboración con el equipo de soporte técnico de Procore.

Nota: Una vez que el identificador de uso compartido se haya añadido al sistema de Procore, la conexión con los bricks de Procore aparecerá en la pestaña Compartido conmigo en Proveedores en su entorno de Databricks. Los datos pueden tardar hasta 24 horas en verse.

- Cuando la conexión de ladrillos de datos Procore sea visible en la pestaña Compartido conmigo , seleccione el identificador de Procore y haga clic en Crear catálogo.

- Introduzca el nombre que prefiera para el catálogo compartido y haga clic en Crear.

- Su catálogo y tablas compartidas ahora se mostrarán con el nombre proporcionado en el Explorador de catálogos.

Póngase en contacto con el soporte técnico de Procore si tiene alguna pregunta o necesita ayuda.

Conectarse a Snowflake usando Python

Resumen

La herramienta Procore Analytics Cloud Connect Access es una interfaz de línea de comandos (CLI) que ayuda a configurar y gestionar las transferencias de datos de Procore a Snowflake.

Consta de dos componentes principales:

- experiencia_usuario.py: Utilidad de configuración

- ds_to_snowflake.py: Script de sincronización de datos

Requisitos

- Python está instalado en su sistema

- Acceso a Procore Delta Share

- credenciales de la cuenta de copo de nieve

- Instale las dependencias necesarias utilizando:

- pip install -r requisitos.txt

Pasos

- Configuración inicial

- Sincronización de datos

- Configuración del origen del recurso compartido delta

- Configuración de destino de copo de nieve

- Opciones de planificación

- Prácticas recomendadas

- Resolución de problemas

Configuración inicial

Ejecute la utilidad de configuración utilizando python user_exp.py.

Sincronización de datos

Después de la configuración, tiene dos opciones para ejecutar la sincronización de datos:

- Ejecución directa:

- pitón ds_to_snowflake.py

- Ejecución planificada

- Si se configura durante la configuración, el trabajo se ejecutará automáticamente de acuerdo con su planificación de Cron.

- Para comprobar los registros de planificación, se creará el archivo `procore_scheduling.log` en cuanto se configure la planificación.

- Además, puede verificar la planificación ejecutando el comando en el terminal:

Para Linux y macOS:

- Para editar/eliminar: edite el cron de planificación usando:

```golpe

EDITOR=nano crontab -e

``` - Después de ejecutar el comando anterior, debería ver algo similar a:

2 * * * *

/Users/su_usuario/copo de nieve/venv/bin/python

/Users/su_usuario/copo de nieve/sql_server_python/connection_config.py

2>&1 | while lee la línea; do echo "$(fecha) - $línea"; hecho>>

/Users/su_usuario/snowflake/sql_server_python/procore_scheduling.log # procore-data-import - También puede ajustar el cron de la planificación o eliminar toda la línea para detener su ejecución según la planificación.

Para Windows:

- Verifique que se haya creado la tarea de planificación:

```

PowerShell

schtasks /query /tn "ProcoreDeltaShareScheduling" /fo LIST /v

```

- Editar/eliminar una tarea de planificación, abra el Planificador de tareas.

- Pulse Win + R, escriba tareaschd.msc, y pulse Intro.

- Vaya a las tareas planificadas.

- En el panel izquierdo, expanda la Biblioteca del planificador de tareas.

- Busque la carpeta donde está guardada su tarea:

Ejemplo: Biblioteca del Planificador de tareas o una carpeta personalizada. - Encuentre su tarea.

- Busque el nombre de la tarea: ProcoreDeltaShareScheduling.

- Haga clic en él para ver los detalles en el panel inferior.

- Verifique su planificación:

- Consulte la pestaña Desencadenadores para ver cuándo está configurada la ejecución de la tarea.

- Consulte la pestaña Historial para confirmar las ejecuciones recientes.

- Para eliminar una tarea:

- Eliminar tarea de la GUI.

Configuración del recurso compartido delta

- Creación del archivo config.share

- Antes de ejecutar la utilidad de configuración, debe crear un archivo config.share con sus credenciales de Delta Share. El archivo debe estar en formato JSON:

{

"shareCredentialsVersion": 1,

"bearerToken": "xxxxxxxxxxxxx",

"endpoint": "https://nvirginia. nube.databricks.c...astores/xxxxxx "

}

- Campos obligatorios:

- ShareCredentialsVersion: número de versión (actualmente 1).

- BearerToken: su token de acceso a recursos compartidos de Delta.

- Punto final: la URL de punto final de su recurso compartido delta.

- Estos detalles se pueden obtener en la interfaz de usuario web de Procore.

- Pasos para crear config.share:

- Cree un nuevo archivo denominado config.share.

- Copie la plantilla JSON anterior.

- Reemplace los valores del marcador de posición por sus credenciales reales.

- Guarde el archivo en una ubicación segura.

- Deberá proporcionar la ruta de acceso a este archivo durante la configuración. Al configurar la fuente de datos, se le pedirá que proporcione:

- Lista de tablas (separadas por comas).

- Deje en blanco para sincronizar todas las tablas.

- Ejemplo: tabla1, tabla2, tabla3.

- Ruta de acceso al archivo config.share.

Configuración de copo de nieve

Deberá proporcionar los siguientes detalles de Snowflake:

- Autenticación (elija una):

- Autenticación de usuario

- Nombre de usuario

- Contraseña (introducida de forma segura)

- Autenticación de usuario

- Autenticación de par de claves

- Nombre de usuario

- Ruta del archivo de clave privada

- Contraseña del archivo de clave privada

- Detalles de conexión:

- Identificador de cuenta

- Nombre de almacén

- Nombre de la base de datos

- Nombre de esquema

- Número de subprocesos simultáneos

Opciones de planificación

La herramienta ofrece la posibilidad de planificar la sincronización automática de datos.

- Configuración de trabajo cron

- Elegir si configurar un proyecto diario

- En caso afirmativo, proporcione una planificación cron

- Formato: * * * * * (minuto hora día del mes mes día de la semana)

- Ejemplo de diario a las 2:00: 0 2 * * *

- Ejecución inmediata

- Opción para ejecutar ds_to_snowflake.py inmediatamente después de la configuración

- Estructura de archivos

desarmar

├── requisitos.txt N.º de dependencias

├── experiencia_usuario.py # Utilidad de configuración

├── ds_to_snowflake.py # Script de sincronización de datos

├── config.yaml # Configuración generada

├── compartir configuración # Archivo de configuración de recurso compartido delta

├── procore_scheduling.log N.º registro de ejecuciones de planificación

Ejemplo de uso- Paso 1: Instalar las dependencias

$ pip install -r requisitos.txt - Paso 2: Ejecutar la utilidad de configuración

$ python experiencia_usuario.py - Acceso a Procore Analytics Cloud Connect

- Esta CLI lo ayudará a elegir la tienda de origen y de destino para acceder a los datos de Procore o escribirlos en Snowflake.

- Pulse Intro para continuar.

- Introduzca la lista de tablas (separadas por comas). Déjelo en blanco para todas las tablas: proyectos, usuarios, tareas.

- Introduzca la ruta a config.share: /ruta/a/config.share.

- Introduzca el nombre de usuario: snowflake_user.

- ¿Qué tipo de autenticación desea utilizar? (usuario/par de llaves): Intro.

- 1 para el usuario,

- 2 por par de claves:

- 1

- Introduzca la contraseña: ********

- Introduzca la cuenta: mi_cuenta

- Introduzca el almacén: mi_almacén

- Introduzca el nombre de la base de datos: procore_db

- Introduzca el nombre del esquema: procore_schema

- Introduzca el número de subprocesos: 4

- ¿Desea configurar esto como un trabajo diario en cron? (Sí/No): Sí

- Introduzca la planificación en formato cron (p. ej., * * * * * ): 0 2 * * *

- ¿Desea ejecutar el trabajo ahora? (Sí/No): Sí

- Paso 3: Ejecución manual (si es necesario)

$ python ds_to_snowflake.py

- Paso 1: Instalar las dependencias

- Reutilización de configuración

La herramienta guarda su configuración en el archivo config.yaml y ofrece reutilizar la configuración almacenada anteriormente:- La configuración de origen se puede reutilizar.

- La configuración de destino (copo de nieve) se puede reutilizar.

- Puede optar por actualizar cualquiera de las configuraciones de forma independiente.

Mejores prácticas

- Autenticación

- Utilice la autenticación de par de claves cuando sea posible.

- Rote regularmente las credenciales.

- Utilice los permisos mínimos necesarios.

- Rendimiento

- Ajuste el número de subprocesos según las capacidades de su sistema.

- Comience con un subconjunto más pequeño de tablas para realizar pruebas.

Resolución de problemas

- Problemas comunes y soluciones:

- Tipo de autenticación no válido

- Asegúrese de seleccionar "1" (usuario) o "2" (par de claves) cuando se le solicite.

- Tipo de autenticación no válido

- Configuración de trabajo cron

- Verifique que tiene los permisos del sistema adecuados.

- Consulte los registros del sistema si el trabajo no se ejecuta.

- Asegúrese de que ds_to_snowflake.py tenga los permisos correctos.

- Verifique la configuración del trabajo cron consultando los registros del sistema:

Consulte el archivo `procore_scheduling.log` .

- Archivo de configuración

- Ubicado en el mismo directorio que el script,

- Llamado config.yaml.

- Haga una copia de seguridad antes de realizar cambios.

- Soporte

- Verifique el resultado del registro del script.

- Revise su archivo config.yaml .

- Póngase en contacto con el administrador del sistema si tiene problemas relacionados con los permisos.

- Póngase en contacto con el soporte técnico de Procore si tiene problemas de acceso a recursos compartidos delta.

Nota: Recuerde siempre hacer una copia de seguridad de su configuración antes de realizar cambios y probar nuevas configuraciones primero en un entorno que no sea de producción.

Conectarse a Amazon S3 mediante Python

Resumen

La herramienta Procore Analytics Cloud Connect Access es una interfaz de línea de comandos (CLI) que ayuda a configurar y gestionar las transferencias de datos de Procore a Amazon S3 con Procore Analytics 2.0.

Consta de dos componentes principales:

- experiencia_usuario.py: Utilidad de configuración

- delta_share_to_s3.py: Script de sincronización de datos

Requisitos

- SKU de Procore Analytics 2.0

- Python está instalado en su sistema

- Acceso a Procore Delta Share

- Teclas de acceso de S3

- Instalación de las dependencias necesarias mediante:

- pip install -r requisitos.txt

Pasos

- Configuración inicial

- Configuración del origen del recurso compartido delta

- Configuración de S3

- Opciones de planificación

- Prácticas recomendadas

- Resolución de problemas

Configuración inicial

Ejecute la utilidad de configuración utilizando python user_exp.py.

Esto le ayudará a configurar lo siguiente:

- Configuración del recurso compartido delta

- Configuración de destino de S3

- Preferencias de planificación

Configuración del recurso compartido delta

- Creación del archivo config.share

- Antes de ejecutar la utilidad de configuración, debe crear un archivo config.share con sus credenciales de Delta Share. El archivo debe estar en formato JSON:

{

"shareCredentialsVersion": 1,

"bearerToken": "xxxxxxxxxxxxx",

"endpoint": "xxxxxx"

}

- Campos obligatorios:

- ShareCredentialsVersion: número de versión (actualmente 1).

- BearerToken: su token de acceso a recursos compartidos de Delta.

- Punto final: la URL de punto final de su recurso compartido delta.

- Estos detalles se pueden obtener en la interfaz de usuario web de Procore.

- Pasos para crear config.share:

- Cree un nuevo archivo denominado config.share.

- Copie la plantilla JSON anterior.

- Reemplace los valores del marcador de posición por sus credenciales reales.

- Guarde el archivo en una ubicación segura.

- Deberá proporcionar la ruta de acceso a este archivo durante la configuración. Al configurar la fuente de datos, se le pedirá que proporcione:

- Lista de tablas (separadas por comas).